Objekt-Eigenschaften

Um Objekte darstellen zu können, projiziert sie Cinema 4D zunächst zentralperspektivisch auf den Bildschirm Ihres Computers. Dabei werden die Objekte aus der Sicht einer virtuellen Kamera abgebildet.

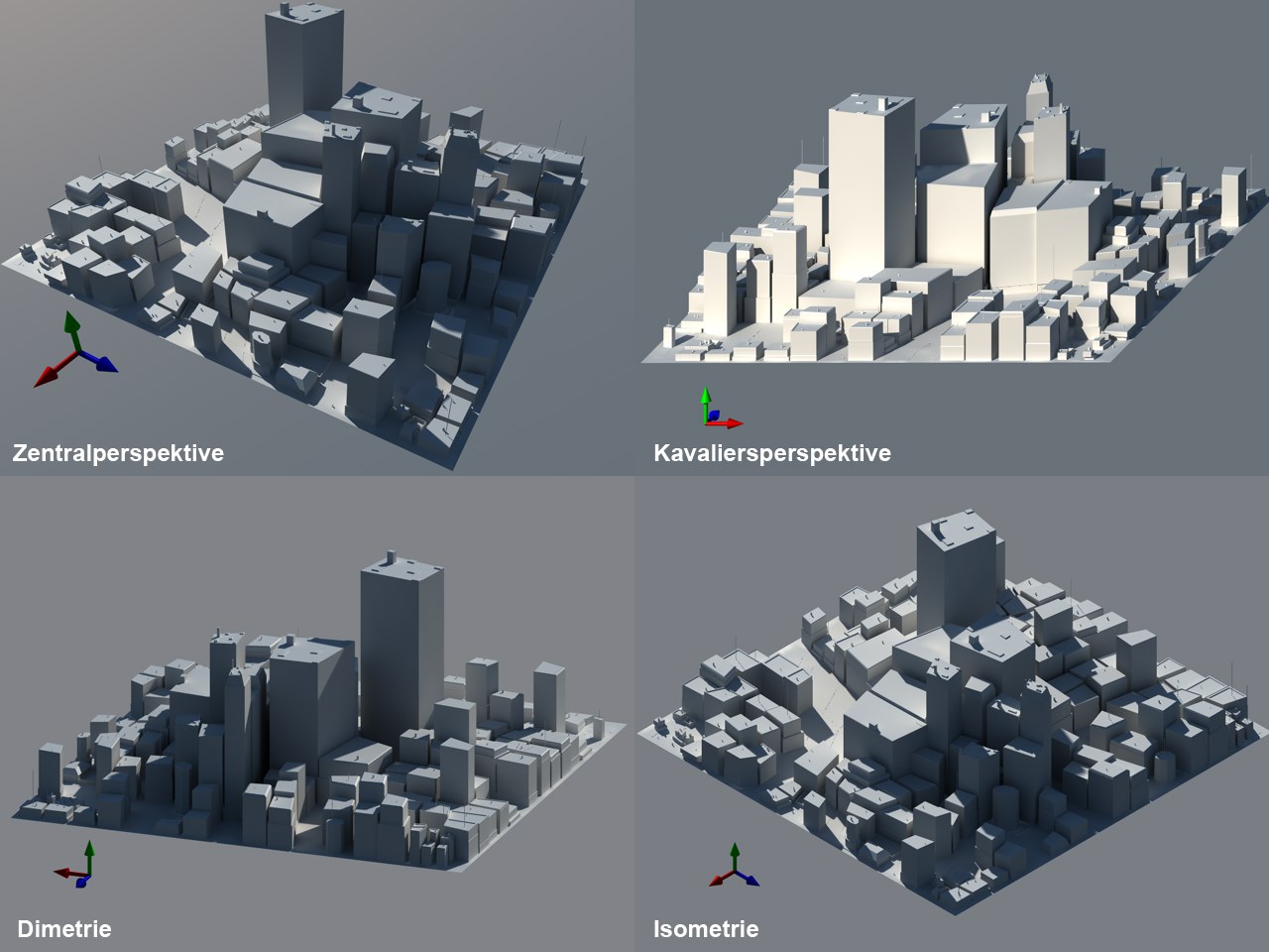

Alternativ können Sie hier aber aus einer Vielfalt anderer Projektionsarten (z.B. der in der Technik häufig verwendeten Dimetrie oder Isometrie) auswählen. Einige Beispiele sehen Sie im Folgenden (oben links – Zentralperspektive, oben rechts – Kavalier-Projektion, unten links – Dimetrie und unten rechts – Isometrie):

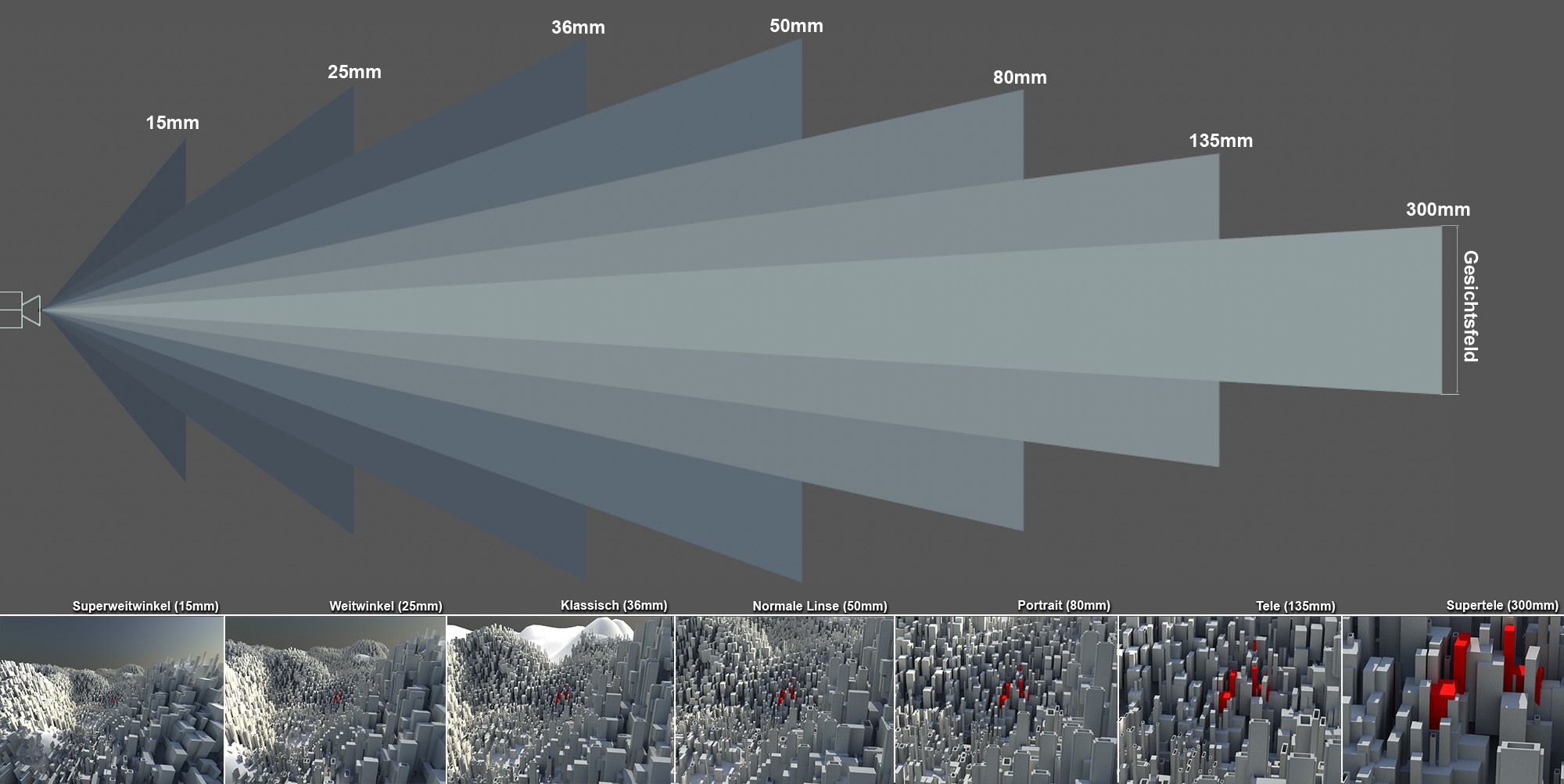

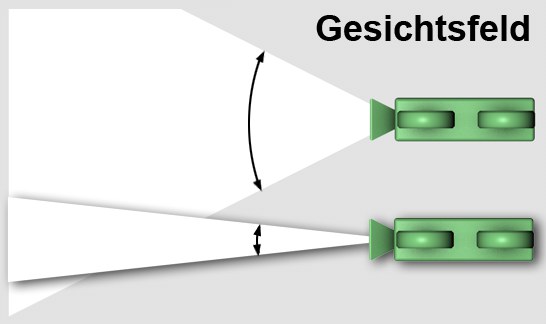

Von links nach rechts zunehmende Brennweiten und damit abnehmendem Gesichtsfeld.

Von links nach rechts zunehmende Brennweiten und damit abnehmendem Gesichtsfeld.In einer echten Kamera entspricht die Brennweite der Entfernung zwischen Linse und Film. Kleine Brennweiten entsprechen Weitwinkelobjektiven und geben einen großen Szenenüberblick, verzerren allerdings auch das Abbild (besonders bei sehr kleinen Brennweiten). Größere Brennweiten zoomen weiter in die Szene. Je größer die Brennweite, desto unverzerrter wird die Abbildung, bis schließlich bei extrem großer Brennweite der perspektivische Tiefeneindruck verloren geht und es zu einer zunehmenden Parallelprojektion kommt.

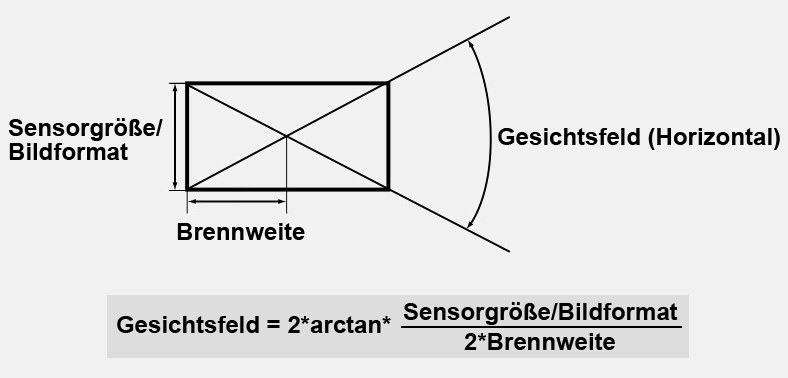

Die Brennweite ist unmittelbar mit dem "Gesichtsfeld" über die in der folgenden Abbildung gezeigten Formel verknüpft.

Größere Brennweiten ergeben ein kleineres Gesichtsfeld und umgekehrt.

Sie können hier eine Reihe von vorgegebenen Brennweiten auswählen, oder auch einen eigenen Wert definieren.

Für die Schärfentiefe (Physikalischer Renderer) gilt: Je größer die Brennweite, desto kleiner ist die Schärfentiefe (Raum in Blickrichtung, der scharf dargestellt wird) und umgekehrt. S.a. Schärfentiefe.

Sensorgröße (Bildformat) [1..2000]

35mm-Äquivalent-Brennweite:

In der echten Kamera bezeichnet dieser Wert die horizontale Film- bzw. Sensorbreite, auf die das Licht in der Kamera fällt. Bei analogen Kleinbildkameras sind das meistens 35mm (technisch tatsächlich 36mm). In der Realität ist dieser Wert meistens konstant und lässt sich nicht ändern, es sei denn Sie kaufen eine andere Kamera.

In Kombination mit der Brennweite ergibt sich dadurch der Parameter Gesichtsfeld (horizontal).

Sie können hier eine Reihe von vorgegebenen Sensorgrößen auswählen, oder bei Auswahl von Benutzerdefiniert einen eigenen Wert definieren. Wenn Sie Sensorgröße (Bildformat) bei gleichbleibender Brennweite ändern, ändert sich ebenfalls das Gesichtsfeld. Eventuelle Schärfentiefe bleibt aber unverändert.

Da die fotografische Welt trotz weitreichender Umstellung auf digitale Sensoren variierender Größe immer noch sehr vertraut mit dem analogen 35mm-Film ist, wird zusätzlich der Wert 35mm-Äquivalent-Brennweite eingeblendet. Alte Hasen können damit auf den Bildausschnitt/Gesichtsfeld bzw. die Vergrößerung der 3D- bzw. digitalen Kamera schließen.

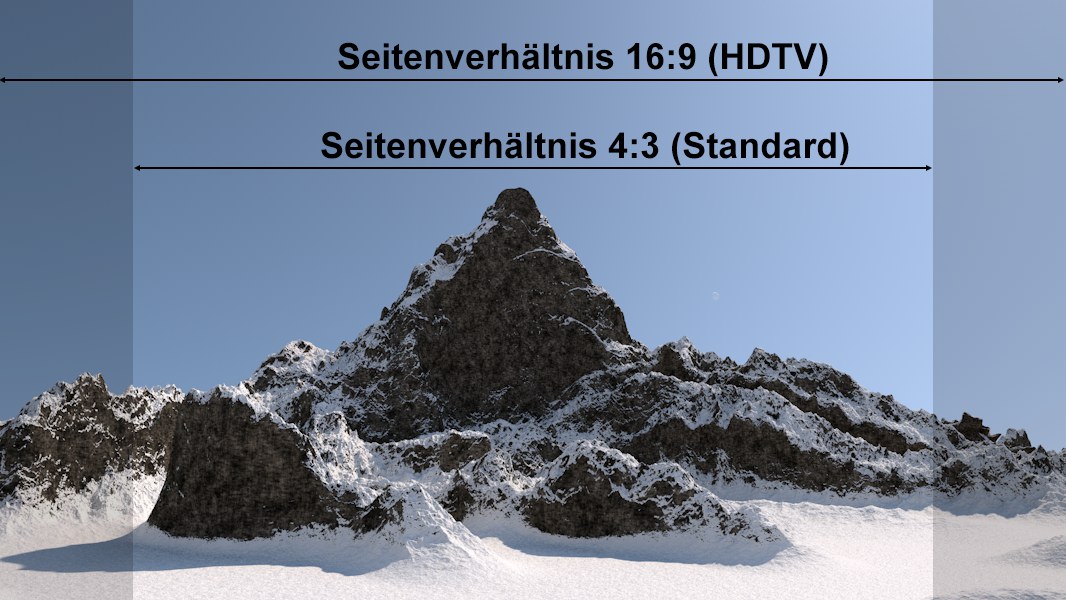

Die Sensorgröße muss justiert werden, wenn das zu rendernde Bildseitenverhältnis bei gleich bleibender Perspektive geändert werden soll.

Verwenden Sie folgende Formel für die Sensorgröße:

Neue Sensorgröße = Alte Sensorgröße * (Neue Breite / Alte Breite)

Beispiel: Sie haben eine Szene, in der das Renderformat auf 800x600 mit einer Sensorgröße von 36mm definiert ist. Sie wollen die Szene jetzt bei gleicher Perspektive im "moderneren" 16:9-Format ausgeben. Ermitteln Sie zunächst die neue Bildbreite: wechseln Sie zu den Rendervoreinstellungen und wählen Sie bei Seitenverhältnis HDTV (16:9). Dabei wird Höhe angepasst, was Sie allerdings nicht wollen. Aktivieren Sie Proportionen erhalten und stellen Sie Höhe zurück auf den alten Wert 600. Es ergibt sich die neue Breite 1066.667.

Diesen Wert setzen Sie jetzt in die in die oben genannte Formel ein. Es ergibt sich Neue Sensorgröße = 36mm * (1066.667/800) = 48mm

Gesichtsfeld (horizontal) [0.2..174°]

Gesichtsfeld (vertikal) [0.2..174°]

Kamera von oben: großes und kleines (horizontales) Gesichtsfeld.

Kamera von oben: großes und kleines (horizontales) Gesichtsfeld.Das Gesichtsfeld stellt den horizontalen bzw. vertikalen Winkel dar, den die Kamera von der Szene sieht. Das Gesichtsfeld ist unmittelbar abhängig von der Brennweite. Je größer die Brennweite, desto kleiner das Gesichtsfeld und umgekehrt. Ein kleines Gesichtsfeld entspricht einer Kamera mit einem Teleobjektiv: da nur ein kleiner Ausschnitt der abzulichtenden Szenerie in die Kamera fällt, ist dieser naturgemäß relativ groß auf dem lichtempfindlichen Teil der Kamera, was einem herangezoomten Bildteil entspricht.

Gesichtsfeld (Vertikal) ändert sich übrigens, wenn Sie das Verhältnis Breite zu Höhe der Rendervoreinstellungen ändern.

Zoom können Sie nur definieren, wenn Sie eine Parallelperspektive (dazu zählen auch die orthografischen Perspektiven wie Oben, Links etc.) verwenden. Der Parameter definiert dann die Skalierung des Bildausschnitts.

Eine besondere Bedeutung hierbei kommt der Zahl 1024 zu. Es gilt nämlich, dass bei einem Zoom-Wert von 1 1024 Cinema 4D-Einheiten abgedeckt werden. Das ist immer dann wichtig, wenn Sie pixelgenaue Renderausgaben brauchen. Beispiel: Sie haben eine Kugel mit dem Durchmesser 120cm. Im Rendering soll die Kugel einen Durchmesser von 120 Pixeln haben. Wie groß muss Zoom sein? Verwenden Sie hier die Formel:

Zoom = 1[Breite*1024, wobei Breite die in den Rendervoreinstellungen (Tab "Ausgabe") definierte ist.

Pixelgenaue Renderausgaben werden z.B. benötigt, wenn Renderings an vorhandenes Bildmaterial angepasst werden sollen (z.B. animierte Masken, Satellitenfotos etc.).

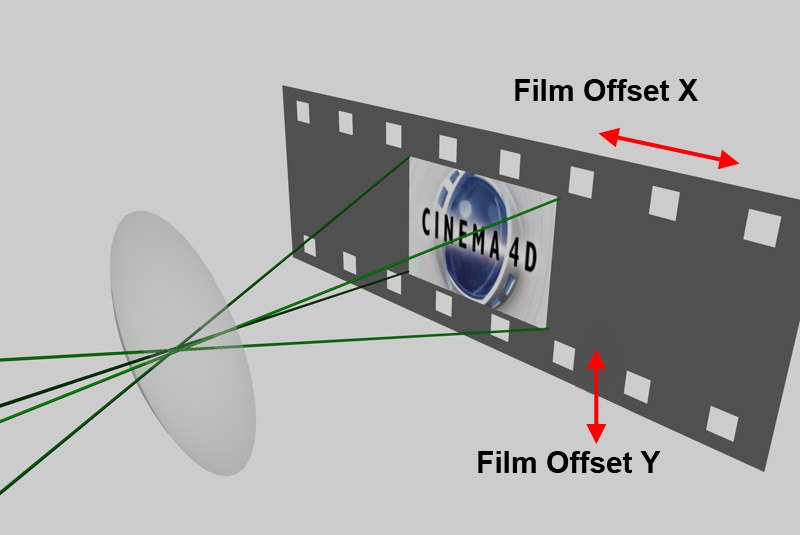

Film Offset X [-∞..+∞%]

Film Offset Y [-∞..+∞%]

Hinter diesen beiden unscheinbaren Parametern verbirgt sich weitaus mehr, als es zunächst den Anschein hat. Aber der Reihe nach.

Funktionsweise von Film Offset

Funktionsweise von Film OffsetWenn Sie sich die Cinema 4D Kamera als echte Filmkamera vorstellen, fällt das Bild durch die Linse auf einen fotografischen Film und wird dort abgebildet. Stellen Sie sich jetzt vor, der Film könnte in X- und Y-Richtung verschoben werden, wobei zusätzliche Bildbestandteile (außerhalb des in obiger Abbildung durch die Eckstrahlen gebildeteten Rechteckes) aufgezeichnet werden. Voilà, genau das machen die beiden Parameter. Cinema 4D geht dabei natürlich einen Schritt weiter, da der Filmstreifen nicht flächenmäßig begrenzt ist.

Aber was bedeutet das in der Praxis?

- Eine Verschiebung des Bildausschnittes ohne Perspektivänderung.

Besonders in der Architekturvisualisierung ist dies zur Nachjustierung des Bildausschnittes geeignet. Die Perspektive und damit die Linienrichtungen und -winkel ändern sich nicht. - Der Wegfall der 16000 x 16000 (32 Bit) bzw. 128000 x 128000 (64 Bit) Pixel Renderbeschränkung.

Mit einem speziellen Trick ist jetzt möglich, beliebig große Bilder zu rendern. Der Trick besteht darin: Animieren Sie die Parameter Filmoffset X und Filmoffset Y in 100%-Schritten und zwar von einem Bild zum nächsten. Sie teilen die Szene sozusagen in mehrere Teile auf, die nacheinander gerendert werden. Als Ausgabeformat wählen Sie ein Bildformat (kein Video).

Nach dem Rendern haben Sie mehrere Einzelbilder (die jeweils für sich genommen natürlich die Seitenlänge von 16000 bzw. 128000 Pixelgröße nicht überschreiten können), die Sie nur noch mit einem Bildbearbeitungsprogramm Ihrer Wahl zusammensetzen.

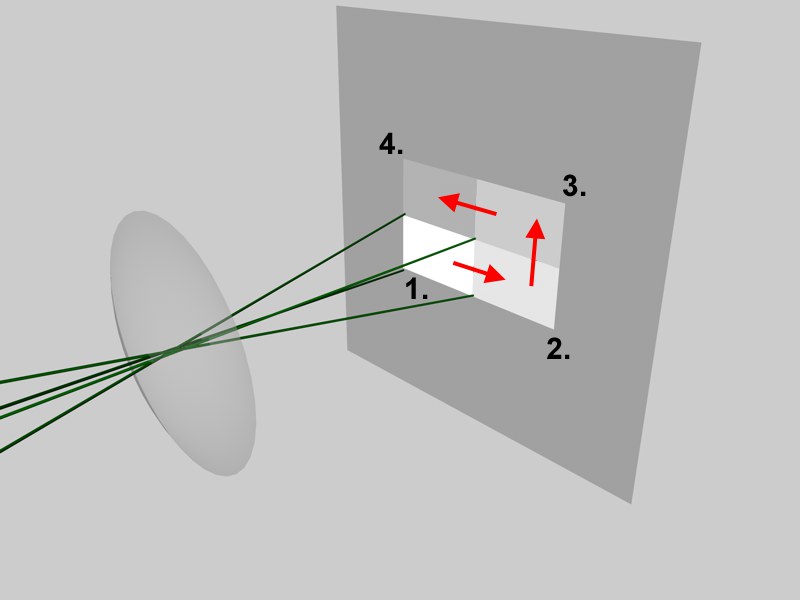

Rendern des animierten Kamera Offsets

Rendern des animierten Kamera OffsetsHier wurde die Szene in 4 Abschnitte aufgeteilt. Das bedeutet, Sie animieren die Parameter Filmoffset X und Filmoffset Y der Kamera über eine Animationslänge von 4 Bildern folgendermaßen:

Bild 0: Filmoffset X/Y: 0% / 0%

Bild 1: Filmoffset X/Y: 100% / 0%

Bild 2: Filmoffset X/Y: 100% / -100%

Bild 3: Filmoffset X/Y: 0% / -100%

Als Resultat erhalten Sie vier Einzelbilder, die Sie beispielsweise mit Adobe Photoshop zusammensetzen können.

Achtung: Dieser und die folgenden 3 Parameter sind primär für den Physikalischen Renderer gedacht.

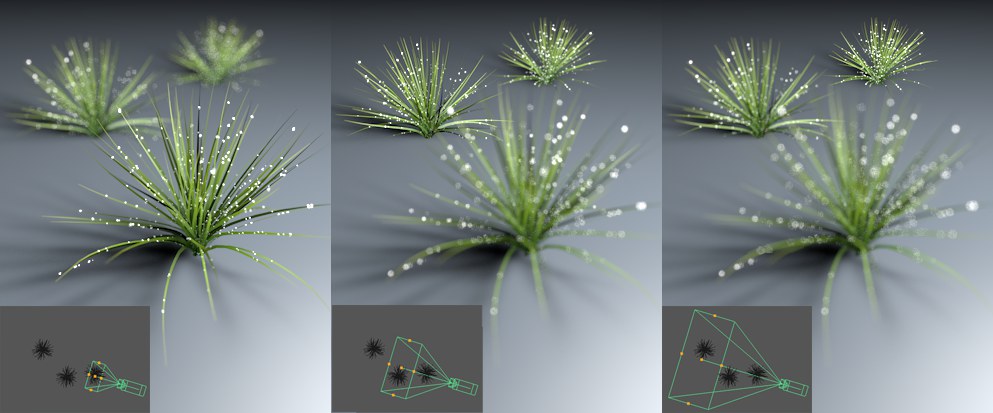

Der Fokus definiert die Schärfenebene.

Der Fokus definiert die Schärfenebene.Die Fokusdistanz – gemessen vom Kameraursprung (=Film- bzw. Sensorebene) – gibt die Entfernung zu einer zur Kamerablickrichtung senkrechten Ebene an, auf der alle Objekte perfekt scharf abgebildet werden. Davor und dahinter werden Objekte zunehmend unscharf berechnet. Dieser Wert kann interaktiv in der Ansicht mit der Maus gesetzt werden, indem Sie den mittleren, vorderen Kameraanfasser verschieben.

Als zweite Funktion definiert dieser Parameter, wo eine Tiefenmap berechnet werden soll (s. Start).

Wenn Sie Szenen real nachbauen, um Schärfentiefeeffekte mit denen von Cinema 4D zu vergleichen, achten Sie darauf, dass die Fokusdistanz nicht beginnend vorne am Objektivende gemessen wird, sondern an der Filmebene der Kamera. Diese ist meistens oben am Kameragehäuse mit einer kleinen (Filmebenen-) Markierung versehen.

Beachten Sie den rechts neben dem Wertefeld angeordneten Auswahlvorgangs-Button. Mit diesem können Sie die Fokusdistanz interaktiv in der 3D-Ansicht (das funktioniert nur in der Zentral- und Parallelperspektive) auf einen Objektpunkt setzen. Die Kamera dreht sich dabei nicht.

Es wird also genau genommen die Entfernung zu einer senkrecht zur Kamerablickrichtung liegenden Ebene, die auf dem angeklickten Objektpunkt liegt, herangezogen.

Wenn die Kamera ein Ausrichten-Expression-Tag besitzt, wird automatisch das dort verwendete Ziel-Objekt zur Berechnung der Fokusdistanz herangezogen.

Die Fokusdistanz kann auch durch ein beliebiges Objekt eingestellt werden. Null-Objekte bieten sich dafür an. Die Kamera dreht sich allerdings nicht in Richtung dieses Objekts. Nur die Entfernung in Kamera-Blickrichtung wird berücksichtigt.

Beachten Sie besonders bei importierten Szenen, wo sich die Objektursprünge (Achsen) im Weltmittelpunkt befinden, dass die Fokusdistanz immer bis zur Achse gerechnet wird. Sie müssten in einem solchen Fall, dann die Achse auf die richtige Position verschieben (der Befehl ![]() Achse zentrieren...

Achse zentrieren...

Weißabgleich (K) [1000..10000]

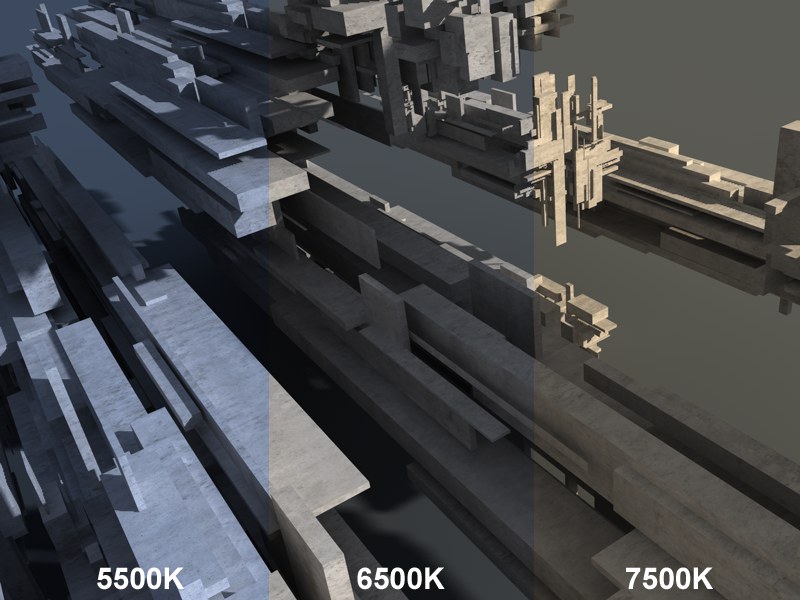

Eine Außenszene (mit Sky) mit 5500K, 6500K und 7500K Kamera-Weißabgleich gerendert.

Eine Außenszene (mit Sky) mit 5500K, 6500K und 7500K Kamera-Weißabgleich gerendert.Beim Weißabgleich geht es im Wesentlichen darum, Einfärbungen durch Lichtquellen (z.B. Himmel, Sonne, Kerzen etc.) bei einem weißen Gegenstand zu verhindern. Der weiße Gegenstand soll auch weiß abgebildet werden. Dazu stellen Sie Weißabgleich ungefähr der Lichtfarbe entsprechend ein (Wolfram bezieht sich übrigens auf den Wolframglühwendel einer Glühbirne).

Wenn Ihnen die Voreinstellungen zu grob sind, können Sie Manuell einstellen und dann bei Eigene Temperatur (K) die Farbtemperatur stufenlos verstellen.

Es können also Farbnuancen eingestellt werden, ohne Lichtfarben verändern zu müssen.

Wie Sie in obiger Abbildung sehen, ist bei 5500K ein klarer Blaustich und bei 7500K ein leichter Gelbstich zu erkennen, während es bei 6500K (übrigens auch passenderweise Tageslicht) zu gräulichen, betonartigen (es wurden Betontexturen verwendet) Strukturen kommt.

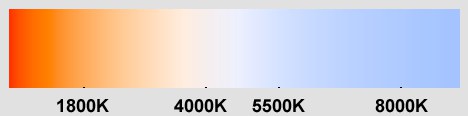

Farbtemperaturen werden in Kelvin gemessen (solcherlei Farben werden bei einem idealisierten glühenden Körper ausgesendet):

Natürlich kann der Weißabgleich auch dazu benutzt werden, Renderings leicht einzufärben. Der neutrale Wert ist Tageslicht (6500K). Allgemein lässt sich sagen, dass kleinere Werte zu einer bläulichen und größere Werte zu einer gelblichen Einfärbung (also genau umgekehrt zu obiger Abbildung; der Weißabgleich ist ja eine Korrektur) führen.

Der Weißabgleich kann über Multi-Passes nicht abgebildet werden.

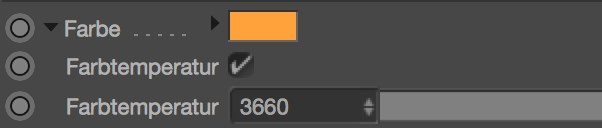

Manchmal kann es einfacher sein, den Weißabgleich nicht in der Kamera vorzunehmen, sondern in der Lichtquelle. Aktivieren Sie dann diese Option.

Aber Achtung, das wirkt dann nur für Lichtquellen, bei denen die Farbe über den Parameter Farbtemperatur (nicht K des Farbwählers) geregelt ist:

Beachten Sie, dass dieser Weißabgleich eine vereinfachte Methode gegenüber dem Kameraweißabgleich (dieser berücksichtigt alles, was ihm vor die Linse kommt) ist und einige Dinge nicht berücksichtigt (z.B. glühende Materialien).

After Effects: Beachten Sie, dass diese Option hier für den unter "2." beschriebenen Austauschweg vorgesehen ist.

Ist die Option aktiviert, wird die Kamera zu den entsprechenden Kompositionsprogrammen exportiert (s.a. hier).